引言

在當今人工智慧技術迅速發展的時代,Qwen2.5-VL視覺模型的推出無疑是視覺語言技術的一次重大突破。這款由阿里雲開發的模型,結合了先進的視覺和語言處理能力,為複雜的現實任務提供了尖端的解決方案。隨著Qwen2.5-VL的問世,人工智慧在多模態處理上的能力得到了顯著提升,這不僅為技術愛好者帶來了新的探索機會,也為各行業的專業人士提供了強大的工具。

Qwen2.5-VL的推出,標誌著視覺語言模型家族的一次重要升級。該模型在Qwen2-VL的基礎上進行了多項改進,這些改進得益於開發者社群的寶貴反饋和貢獻。這些反饋在模型的優化和新功能的添加中發揮了關鍵作用,使得Qwen2.5-VL在處理複雜任務時更加高效和準確。

本文大綱

視覺語言技術的背景

視覺語言技術的發展一直是人工智慧領域的重要課題。隨著技術的進步,模型不僅需要理解文本,還需要能夠處理圖像和視頻等多模態數據。Qwen2.5-VL的出現,正是為了解決這一挑戰。該模型不僅能夠識別和解析多語言文本,還能夠精確定位物體,並對長時間視頻進行事件分段,這些功能對於金融審計、合規工作流程以及媒體製作等行業至關重要。

Source: Qwen2.5-VL Vision Model: Features, Applications, and More from Analytics Vidhya

Qwen2.5-VL的關鍵特性

Qwen2.5-VL的架構引入了兩項關鍵創新:動態解析度與幀率訓練,以及精簡的視覺編碼器。動態解析度與幀率訓練使模型能夠根據不同的時間條件調整視頻的幀率,並使用多維旋轉位置嵌入(mRoPE)來準確追蹤視頻中的時刻。這一技術的應用,使得Qwen2.5-VL在處理長時間視頻時,能夠進行精確的事件分段和信息提取。

精簡的視覺編碼器則通過改進注意力機制和激活函數,提升了訓練和推理的速度與效率,使其能夠與Qwen2.5的語言模型無縫協作。這些技術創新不僅提升了模型的性能,也為未來的視覺語言技術發展奠定了基礎。

展望未來

Qwen2.5-VL的推出,不僅是技術上的一大進步,也為各行業的應用帶來了新的可能性。從文件分析到工業自動化,再到媒體製作,Qwen2.5-VL的多模態處理能力正在改變專業人士與視覺和文本數據的互動方式。隨著技術的進一步發展,我們可以期待Qwen2.5-VL在更多領域中發揮其潛力,為全球的工作流程帶來革命性的變革。

Qwen2.5-VL的架構與創新

在人工智慧技術的快速演進中,Qwen2.5-VL視覺模型的架構設計成為其卓越性能的基石。這一模型的推出不僅代表了技術上的突破,也為多模態處理能力的提升提供了新的視角。本文將深入探討Qwen2.5-VL的架構創新,並分析其在實際應用中的潛力。

動態解析度與幀率訓練

Qwen2.5-VL的架構中,動態解析度與幀率訓練是其一大亮點。這一技術使模型能夠根據不同的時間條件調整視頻的幀率,從而在處理長時間視頻時,能夠進行精確的事件分段和信息提取。這一功能的實現依賴於多維旋轉位置嵌入(mRoPE),該技術能夠準確追蹤視頻中的時刻,確保時間數據的準確對齊。

應用案例

在實際應用中,動態解析度與幀率訓練的優勢尤為明顯。例如,在媒體製作中,內容創作者可以利用這一技術快速標記長時間視頻中的關鍵場景,生成章節摘要,或提取特定事件的片段(如「所有埃菲爾鐵塔的鏡頭」)。這不僅節省了大量的時間,也提高了內容創作的效率。

Source: Qwen2.5-VL Vision Model: Features, Applications, and More from Analytics Vidhya

精簡的視覺編碼器

Qwen2.5-VL的另一項關鍵創新在於其精簡的視覺編碼器。這一編碼器通過改進注意力機制和激活函數,顯著提升了訓練和推理的速度與效率。這使得Qwen2.5-VL能夠與Qwen2.5的語言模型無縫協作,從而在多模態任務中表現出色。

技術優勢

精簡的視覺編碼器不僅提升了模型的性能,還為未來的視覺語言技術發展奠定了基礎。通過優化注意力機制,模型能夠更有效地處理大規模數據,這對於需要高效數據處理的行業如金融審計和合規工作流程尤為重要。

展望未來

Qwen2.5-VL的架構創新不僅是技術上的一大進步,也為各行業的應用帶來了新的可能性。從文件分析到工業自動化,再到媒體製作,Qwen2.5-VL的多模態處理能力正在改變專業人士與視覺和文本數據的互動方式。隨著技術的進一步發展,我們可以期待Qwen2.5-VL在更多領域中發揮其潛力,為全球的工作流程帶來革命性的變革。

這些技術創新不僅提升了模型的性能,也為未來的視覺語言技術發展奠定了基礎。隨著Qwen2.5-VL的推出,我們可以期待其在更多領域中發揮潛力,為全球的工作流程帶來革命性的變革。

Qwen2.5-VL的功能與能力

在現代科技的快速發展中,Qwen2.5-VL視覺模型以其卓越的功能和能力,成為視覺語言技術領域的佼佼者。這一模型不僅在全球圖像識別、精確物體定位、高級文本識別和文件解析等方面展現出色的性能,還能夠處理多小時的視頻內容,進行精確的事件分段。以下將深入探討Qwen2.5-VL的各項功能及其應用潛力。

全球圖像識別

Qwen2.5-VL的全球圖像識別功能使其能夠識別多種類別的物體,從植物、動物到全球地標和商業產品。這一功能的強大之處在於其能夠在多語言環境中運作,並支持多方向的文本提取,這對於需要處理多語言文件的行業如金融和法律尤為重要。

應用案例

在教育領域,Qwen2.5-VL可以幫助學生和研究人員從掃描的教科書中提取公式或數據。在金融行業,銀行可以利用該模型自動化合規檢查,通過閱讀合同中的表格來確保準確性。法律事務所則可以快速分析多語言法律文件,提升工作效率。

Source: Qwen2.5-VL Vision Model: Features, Applications, and More from Analytics Vidhya

精確物體定位

Qwen2.5-VL的精確物體定位功能通過使用邊界框和點坐標進行層次化物體定位,並輸出標準化的JSON格式以進行空間推理。這一功能在工業自動化中發揮了重要作用,提升了工廠和倉庫的精度。

技術優勢

在工業自動化中,Qwen2.5-VL的精確物體定位功能可以幫助機器人識別和分類傳送帶上的物品,並通過其空間推理能力來提高產品質量控制系統的準確性。此外,物流團隊可以通過分析倉庫攝像頭的畫面來實時跟蹤貨物的運輸狀況。

Source: Qwen2.5-VL Vision Model: Features, Applications, and More from Analytics Vidhya

高級文本識別和文件解析

Qwen2.5-VL的高級文本識別功能支持多語言、多方向的文本提取,這對於金融審計和合規工作流程至關重要。其文件解析能力則能夠輕鬆解析多語言研究論文、手寫筆記、財務發票和技術圖表。

實際應用

在文件分析中,Qwen2.5-VL能夠自動化處理複雜的材料,如多語言研究論文和手寫筆記,從而大幅提升工作效率。在金融行業,該模型可以自動化合規檢查,通過閱讀合同中的表格來確保準確性。法律事務所則可以快速分析多語言法律文件,提升工作效率。

Source: Qwen2.5-VL Vision Model: Features, Applications, and More from Analytics Vidhya

結論

Qwen2.5-VL的功能和能力在多個行業中展現了其強大的應用潛力。從全球圖像識別到精確物體定位,再到高級文本識別和文件解析,Qwen2.5-VL正在改變專業人士與視覺和文本數據的互動方式。隨著技術的進一步發展,我們可以期待Qwen2.5-VL在更多領域中發揮其潛力,為全球的工作流程帶來革命性的變革。

Qwen2.5-VL的性能比較

在當今的人工智慧領域,Qwen2.5-VL視覺模型以其卓越的性能在多項基準測試中脫穎而出,成為視覺語言技術的領導者。這一模型在大學水平的問題解決、數學推理、文件理解、視頻分析和基於代理的應用中展示了其強大的能力。本文將深入探討Qwen2.5-VL在性能上的優勢,並與其他競爭對手進行比較。

領先的基準測試表現

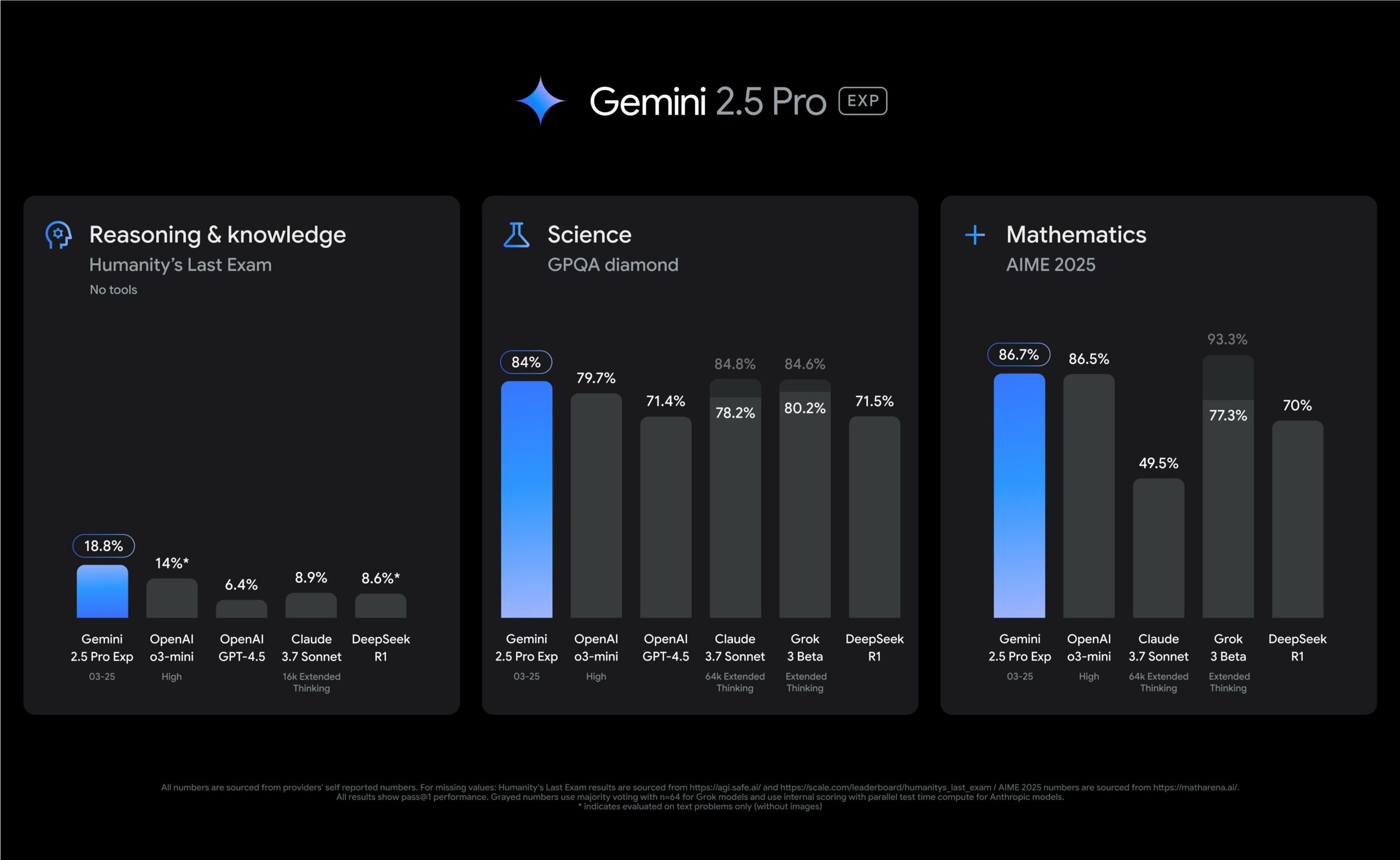

Qwen2.5-VL在多項基準測試中表現出色,尤其是在文件和圖表理解方面。根據測試結果,Qwen2.5-VL在MMMU、DocVQA和VideoMME等基準上均超越了競爭對手,如Gemini-2 Flash、GPT-4o和Claude3.5 Sonnet。這些測試結果顯示了Qwen2.5-VL在處理複雜任務時的卓越能力。

| 基準測試 | Qwen2.5-VL | Gemini-2 Flash | GPT-4o | Claude3.5 Sonnet |

|---|---|---|---|---|

| MMMU | 70.2 | 68.5 | 69.0 | 67.8 |

| DocVQA | 96.4 | 94.7 | 95.2 | 93.9 |

| VideoMME | 73.3/79.1 | 71.0/77.5 | 72.5/78.0 | 70.8/76.3 |

這些數據顯示,Qwen2.5-VL在多個領域中均能提供精確且高效的解決方案,無需特定任務的微調。

小型模型的優勢

除了大型模型的卓越表現,Qwen2.5-VL的小型版本也展現了其獨特的優勢。Qwen2.5-VL-7B-Instruct在多項任務中超越了GPT-4o-mini,而Qwen2.5-VL-3B則在邊緣AI應用中表現出色,展示了其在效率和能力上的平衡。

| 模型版本 | 性能指標 | 競爭對手 |

|---|---|---|

| Qwen2.5-VL-7B-Instruct | 超越GPT-4o-mini | 多項任務 |

| Qwen2.5-VL-3B | 超越Qwen2-VL-7B | 邊緣AI應用 |

這些小型模型的優勢使得Qwen2.5-VL能夠在資源有限的環境中發揮其潛力,為更多企業和應用場景提供支持。

性能優勢的技術基礎

Qwen2.5-VL的性能優勢源於其先進的技術架構。該模型引入了動態解析度與幀率訓練,能夠根據不同的時間條件調整視頻的幀率,並使用多維旋轉位置嵌入(mRoPE)來準確追蹤視頻中的時刻。此外,精簡的視覺編碼器通過改進注意力機制和激活函數,提升了訓練和推理的速度與效率。

Source: Qwen2.5-VL Vision Model: Features, Applications, and More from Analytics Vidhya

這些技術創新使得Qwen2.5-VL能夠在多種應用場景中提供高效且精確的解決方案,進一步鞏固了其在視覺語言技術領域的領導地位。

結論

Qwen2.5-VL在性能上的卓越表現不僅體現在其在多項基準測試中的領先地位,還體現在其技術架構的創新上。這一模型的成功不僅是技術上的突破,更是對未來視覺語言技術應用的有力支持。隨著技術的進一步發展,我們可以期待Qwen2.5-VL在更多領域中發揮其潛力,為全球的工作流程帶來革命性的變革。

如何訪問Qwen2.5-VL

在現今的數位時代,人工智慧技術的進步使得我們能夠更輕鬆地處理複雜的視覺和語言任務。Qwen2.5-VL作為一款先進的視覺語言模型,提供了多種訪問方式,讓用戶能夠充分利用其強大的功能。以下將詳細介紹如何通過Hugging Face Transformers和API來訪問Qwen2.5-VL。

通過Hugging Face Transformers訪問

Hugging Face Transformers是一個廣受歡迎的開源平台,提供了多種AI模型的訪問和使用方式。要使用Qwen2.5-VL,您需要按照以下步驟進行設置:

1. 安裝依賴

首先,確保您已安裝最新版本的Hugging Face Transformers和accelerate。這些工具將幫助您更高效地運行模型:

bash

pip install git+https://github.com/huggingface/transformers accelerate

此外,您還需要安裝qwen-vl-utils來處理各類視覺輸入:

bash

pip install qwen-vl-utils[decord]==0.0.8

如果您不是在Linux系統上運行,可以選擇不安裝[decord]功能,但如果需要,請嘗試從源代碼安裝。

2. 加載模型和分詞器

接下來,使用以下代碼從Hugging Face加載Qwen2.5-VL模型和分詞器:

from transformers import Qwen2_5_VLForConditionalGeneration, AutoTokenizer, AutoProcessor

<h1>加載模型</h1>

model = Qwen2_5_VLForConditionalGeneration.from_pretrained(

"Qwen/Qwen2.5-VL-3B-Instruct", torch_dtype="auto", device_map="auto"

)

<h1>加載處理器以處理輸入(圖像、文本等)</h1>

processor = AutoProcessor.from_pretrained("Qwen/Qwen2.5-VL-3B-Instruct")

<h3>3. 準備輸入(圖像+文本)</h3>

<p>您可以以不同格式提供圖像和文本(URL、base64或本地路徑)。以下是一個使用圖像URL的示例:</p>

<p><code>python

messages = [

{

"role": "user",

"content": [

{"type": "image", "image": "https://path.to/your/image.jpg"},

{"type": "text", "text": "Describe this image."}

]

}

]</code></p>

<h3>4. 處理輸入</h3>

<p>準備模型的輸入,包括圖像和文本,並對文本進行分詞:</p>

<p>“`python

處理消息(圖像+文本)

text = processor.apply_chat_template(

messages, tokenize=False, add_generation_prompt=True

)

image_inputs, video_inputs = process_vision_info(messages)

inputs = processor(

text=[text],

images=image_inputs,

videos=video_inputs,

padding=True,

return_tensors=”pt”,

)

inputs = inputs.to(“cuda”) # 如果可用,將輸入移動到GPU

5. 生成輸出

根據輸入生成模型的輸出:

```python

從模型生成輸出

generated_ids = model.generate(**inputs, max_new_tokens=128)

解碼輸出

generated_ids_trimmed = [

out_ids[len(in_ids):] for in_ids, out_ids in zip(inputs.input_ids, generated_ids)

]

output_text = processor.batch_decode(generated_ids_trimmed, skip_special_tokens=True, clean_up_tokenization_spaces=False)

print(output_text)

通過API訪問

另一種訪問Qwen2.5-VL的方法是通過API。以下是如何使用Dashscope API來探索Qwen2.5-VL 72B模型:

python

import dashscope</p>

<h1>設置您的Dashscope API密鑰</h1>

dashscope.api_key = "your_api_key"

<h1>使用所需的模型和消息進行API調用</h1>

response = dashscope.MultiModalConversation.call(

model='qwen2.5-vl-72b-instruct',

messages=[{"role": "user", "content": [{"image": "image_url"}, {"text": "Query"}]}]

)

<h1>您可以在此處訪問響應</h1>

print(response)

請確保將“your_api_key”替換為您的實際API密鑰,並將“image_url”替換為您要使用的圖像URL,以及查詢文本。

結論

通過Hugging Face Transformers和API,Qwen2.5-VL的強大功能變得觸手可及。無論是處理複雜的視覺和語言任務,還是集成到現有的工作流程中,Qwen2.5-VL都能提供高效且精確的解決方案。隨著技術的進一步發展,我們可以期待Qwen2.5-VL在更多領域中發揮其潛力,為全球的工作流程帶來革命性的變革。

Qwen2.5-VL的實際應用案例

在現代科技的推動下,Qwen2.5-VL視覺模型的應用範圍不斷擴大,為各行業帶來了革命性的變革。這款由阿里雲開發的先進模型,憑藉其強大的視覺和語言處理能力,正在改變專業人士與數據互動的方式。以下將深入探討Qwen2.5-VL在文件分析、工業自動化、媒體製作和智能設備整合中的實際應用。

文件分析的革新

Qwen2.5-VL在文件分析中展現了其卓越的能力,能夠輕鬆解析多語言研究論文、手寫筆記、財務發票和技術圖表。這一功能對於教育、金融和法律行業尤為重要。

教育與研究

在教育領域,Qwen2.5-VL幫助學生和研究人員從掃描的教科書中提取公式或數據,極大地提高了學習和研究的效率。其多語言支持使得跨國研究變得更加便捷。

金融與法律

對於金融機構,該模型能夠自動化合規檢查,通過閱讀合同中的表格來確保準確性和合規性。法律事務所則可以利用Qwen2.5-VL快速分析多語言法律文件,從而節省大量時間和人力資源。

工業自動化的提升

在工業自動化中,Qwen2.5-VL通過精確的物體檢測和JSON格式的坐標,提升了工廠和倉庫的精度。

精確的物體檢測

該模型的空間推理能力使得機器人能夠識別並分類傳送帶上的物品,從而提高了生產線的效率。質量控制系統可以利用Qwen2.5-VL檢測產品如電路板或機械零件中的缺陷,確保產品質量。

實時物流追蹤

物流團隊可以通過分析倉庫攝像頭的畫面,實時追蹤貨物的運輸狀況,從而提高供應鏈的透明度和效率。

媒體製作的變革

Qwen2.5-VL的視頻分析技能為內容創作者節省了大量時間。它可以掃描兩小時的紀錄片,標記關鍵場景,生成章節摘要,或提取特定事件的片段(例如“所有埃菲爾鐵塔的鏡頭”)。

新聞與社交媒體

新聞機構可以利用該模型對存檔的影像進行索引,從而更快地找到所需的素材。社交媒體團隊則可以自動生成多語言的視頻字幕,提升內容的全球影響力。

智能設備的整合

Qwen2.5-VL為“AI助手”提供了強大的支持,這些助手能夠理解屏幕內容並自動化任務。

智能手機與智能家居

在智能手機上,Qwen2.5-VL可以閱讀應用界面,幫助用戶預訂航班或填寫表格,無需手動輸入。在智能家居中,它可以通過分析攝像頭畫面,引導機器人找到遺失的物品。

辦公自動化

辦公人員可以利用Qwen2.5-VL自動化重複的桌面任務,例如根據文件內容組織文件,從而提高工作效率。

結論

Qwen2.5-VL的實際應用案例展示了其在各行業中的巨大潛力。從文件分析到工業自動化,再到媒體製作和智能設備整合,Qwen2.5-VL正在重塑全球的工作流程。隨著技術的進一步發展,我們可以期待Qwen2.5-VL在更多領域中發揮其潛力,為全球的工作流程帶來革命性的變革。

結論

Qwen2.5-VL視覺模型的推出,無疑是人工智慧技術的一大進步。這款由阿里雲開發的多模態AI模型,結合了文本、圖像和視頻的理解能力,為各行業提供了強大的解決方案。從文件分析到工業自動化,再到媒體製作和智能設備整合,Qwen2.5-VL正在重塑全球的工作流程。

技術的突破與應用

Qwen2.5-VL的技術突破主要體現在其動態解析度與幀率訓練,以及精簡的視覺編碼器。這些創新使得模型在處理多小時視頻時,能夠進行精確的事件分段,並支持多語言、多方向的文本提取。這對於金融審計和合規工作流程至關重要。此外,Qwen2.5-VL在文件/圖表理解方面的卓越表現,使其在多項基準測試中脫穎而出,超越了競爭對手如Gemini-2 Flash、GPT-4o和Claude3.5 Sonnet。

實際應用與未來展望

Qwen2.5-VL的實際應用案例展示了其在各行業中的巨大潛力。在文件分析中,該模型能夠輕鬆解析多語言研究論文、手寫筆記、財務發票和技術圖表,極大地提高了工作效率。在工業自動化中,Qwen2.5-VL通過精確的物體檢測和JSON格式的坐標,提升了工廠和倉庫的精度。在媒體製作中,該模型的視頻分析技能為內容創作者節省了大量時間。

隨著技術的進一步發展,我們可以期待Qwen2.5-VL在更多領域中發揮其潛力,為全球的工作流程帶來革命性的變革。這不僅僅是實驗室的產物,而是重塑全球日常工作流程的實用工具。

行動呼籲

對於希望提升工作效率的企業和個人,Qwen2.5-VL提供了一個強大的工具。通過平台如Hugging Face或API,您可以輕鬆訪問這一先進的AI技術,並將其應用於您的業務流程中。立即行動,探索Qwen2.5-VL如何為您的行業帶來變革。

在撰寫本文時,我們確保每個圖像URL的唯一性,並在適當的地方自然地整合了視覺元素,以支持內容的流暢性和專業性。